Hawking, Musk mengupayakan larangan penggunaan kecerdasan buatan yang dipersenjatai

keren989

- 0

Ini adalah ringkasan yang dibuat oleh AI, yang mungkin memiliki kesalahan. Untuk konteksnya, selalu rujuk artikel selengkapnya.

Stephen Hawking dan Elon Musk dari Tesla termasuk di antara mereka yang menandatangani surat terbuka yang memperingatkan konsekuensi pengembangan senjata yang dilengkapi AI, yang bisa jatuh ke tangan teroris, diktator, dan panglima perang.

MANILA, Filipina – Lebih dari 1.000 orang, terdiri dari tokoh-tokoh teknologi, peneliti AI dan robotika, serta akademisi, mengeluarkan surat terbuka pada hari Selasa, 28 Juli, memperingatkan terhadap apa yang mereka sebut sebagai “perlombaan senjata AI (kecerdasan buatan) militer.”

Surat terbuka yang diterbitkan oleh Future of Life Institute mendesak masyarakat untuk tidak memulai perlombaan untuk mengembangkan AI perang militer terbaik dan untuk “melarang senjata otonom ofensif yang berada di luar kendali manusia.”

Mereka yang menandatangani surat tersebut antara lain Stephen Hawking, Elon Musk dari Tesla, salah satu pendiri Apple Steve Wozniak, dan CEO Google Deepmind Demis Hassabis.

Surat tersebut menjelaskan bahwa jika suatu kekuatan militer terus mengembangkan senjata yang dilengkapi AI, hal ini berpotensi menjadi awal perlombaan senjata baru antar negara.

“Tidak seperti senjata nuklir,” lanjut surat terbuka itu, “senjata ini tidak memerlukan bahan baku yang mahal atau sulit ditemukan, sehingga senjata ini akan tersedia di mana-mana dan murah bagi semua kekuatan militer untuk memproduksinya secara massal. Ini hanya masalah waktu saja. sampai mereka muncul di pasar gelap dan di tangan teroris, diktator yang ingin mengendalikan penduduknya dengan lebih baik, panglima perang yang ingin melakukan pembersihan etnis, dan sebagainya.

Surat tersebut menambahkan, “Senjata otonom ideal untuk tugas-tugas seperti pembunuhan, destabilisasi negara, penaklukan populasi, dan kematian selektif kelompok etnis tertentu. Oleh karena itu, kami percaya bahwa perlombaan senjata AI militer tidak akan bermanfaat bagi umat manusia. menjadi.”

Kecerdasan buatan, jelas surat terbuka itu, dapat digunakan untuk membuat medan perang lebih aman bagi warga sipil dan orang lain tanpa perlu membuat alat baru untuk membunuh. Hal ini juga akan mengurangi reaksi masyarakat terhadap kecerdasan buatan yang dapat berdampak negatif terhadap manfaat masa depan bagi masyarakat.

Penjaga menambahkan bahwa Inggris menentang larangan pengembangan senjata otonom pada konferensi PBB di Jenewa pada bulan April, meskipun ada tekanan dari kelompok anti-otonom. – Rappler.com

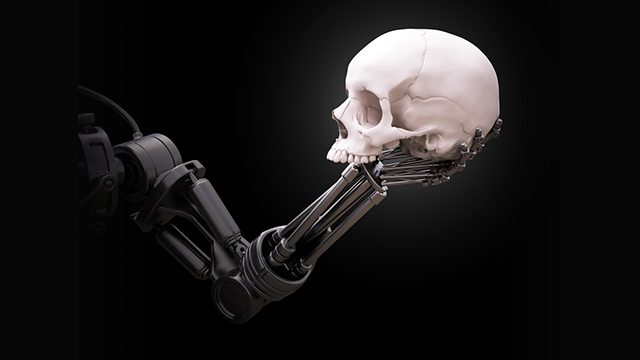

Lengan robot memegang gambar tengkorak manusia melalui ShutterStock